WEITERE NEWS

WEITERE NEWS

- Springer Nature kommt laut neuem Nachhaltigkeitsbericht bei Reduzierung von CO2-Emissionen gut voran

- Woche der Meinungsfreiheit 2024: Vielfältiges Programm für Demokratie, Debatte und Frieden

- Colloquium Fundamentale zur Frage Was ist Freiheit?

- ZBW Leibniz-Informationszentrum Wirtschaft an neuem Leibniz-Lab Systemische Nachhaltigkeit beteiligt

- Germanistische Linguistik in neuem Gewand

- TIB unterzeichnet Barcelona Declaration on Open Research Information

- Bedeutende Ankäufe für Musiksammlung

- Neues Feature für mehr Transparenz: ZB MED-Suchportal LIVIVO macht zurückgezogene Publikationen deutlich erkennbar

Aktuelles aus

L

ibrary

Essentials

In der Ausgabe 2/2024

- Need to have

statt nice to have.

Die Evolution

der Daten in der Forschungsliteratur - Open-Access-Publikationen: Schlüssel zu höheren Zitationsraten

- Gen Z und Millennials lieben

digitale Medien UND Bibliotheken - Verliert Google seinen Kompass?

Durch SEO-Spam werden

Suchmaschinen zum Bingospiel - Die Renaissance des gedruckten Buches: Warum physische Bücher in der digitalen Welt relevant bleiben

- KI-Halluzinationen: Ein Verwirrspiel

- Die Technologie-Trends des Jahres 2024

- KI-Policies und Bibliotheken: Ein globaler Überblick und Handlungsempfehlungen

- Warum Bücherklauen aus der Mode gekommen ist

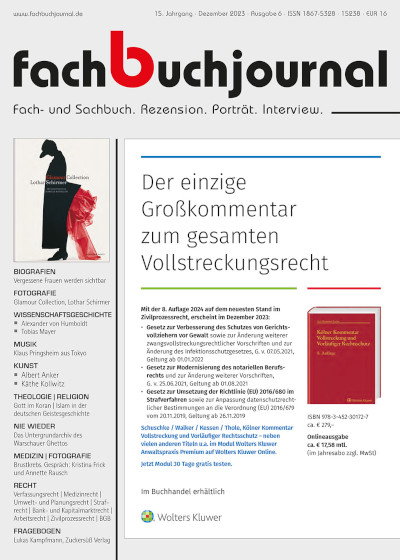

fachbuchjournal

Ausgabe 6 / 2023

BIOGRAFIEN

Vergessene Frauen werden sichtbar

FOTOGRAFIE

In Lothars Bücherwelt walten magische Kräfte.

Glamour Collection, Lothar Schirmer, Katalog einer Sammlung

WISSENSCHAFTSGESCHICHTE

Hingabe an die Sache des Wissens

MUSIK

Klaus Pringsheim aus Tokyo

Ein Wanderer zwischen den Welten

MAKE METAL SMALL AGAIN

20 Jahre Malmzeit

ASTRONOMIE

Sonne, Mond, Sterne

LANDESKUNDE

Vietnam der aufsteigende Drache

MEDIZIN | FOTOGRAFIE

Und ja, mein einziger Bezugspunkt

bin ich jetzt selbst

RECHT

Stiftungsrecht und Steuerrecht I Verfassungsrecht I Medizinrecht I Strafprozessrecht

uvm